Härom dagen briserade ännu en oroande nyhet om det amerikanska presidentvalet 2016. Facebook suspenderade analysföretaget Cambridge Analytica från sin plattform efter misstankar att de använt persondata på otillåtet sätt. Detaljerna i fallet är skrämmande på flera olika nivåer.

I grunden är det fall som ligger just nu oroande. Cambridge Analytica (ett brittiskt analys- och rådgivningsföretag grundat av en konservativ amerikansk fondmäklare) har samlat in uppgifter om 50 miljoner FB-användare. De har sedan potentiellt använt denna data för att på otillåtet sätt påverka valet 2016 i Trumps favör.

Men utöver just detta fall finns ju en annan, mer generell oro; människors naivitet kring data och hur de som har kunskap och onda avsikter potentiellt kan utnyttja ny teknik för otillåten påverkan. CA:s metodik har egentligen varit barnsligt enkel; De sätter upp facebook-tester av typen ”Vilket parti borde jag rösta på”, eller ”Vilken kändis är du mest lik”. När folk använder dessa tester klickar de glatt i att den som skapat testet får tillgång till all deras persondata på Facebook. Den enskilde individen förstår då inte att de givit utgivaren av testet rätt att kolla på och analysera deras ålder, hemstad, intressen och allt de likeat på Facebook. De förstår inte heller att denna information används för att skapa den bästa och mest riktade kampanjen för Trump som går att skapa. De hade ju bara gjort ett test.

Det här resonemanget kan man ju bredda till även parter som kanske inte har onda avsikter kring nya digitala verktyg, utan bara dålig koll. Facebook är ju en plattform där man lätt kan räka dela mer data än man egentligen tänkt sig, men det finns fler. Ett vanligt exempel är retargeting-banners. Hemsides-besökare lämnar med cookies ifrån sig digitala spår om hur de rört sig och vad de gjort på en sajt, vilket sajtägaren sen kan använda till att på en informerat, genomtänkt och försiktigt vis bearbeta kunden vidare för att få till en konvertering. Eller så bombar de sänder besökaren med 200 banners per dag som gör reklam för samma produkt som hen just köpt.

Det dyker alltså upp nya tekniker som varken konsumenter eller institutioner har full koll på hur de bör användas på bästa sätt. Eller hur de kan användas på värsta sätt av en ondsint part.

Ny teknik används alltid lite slarvigt innan vi fått koll på den, innan regleringar och konsumenters skepticism byggs upp. Bilen är ju en ganska användingsbar grej, men innan vi fick koll på säkerhetbälten, alkohollagstifning, trafikregler (och innan vi lärde oss köra ordentligt) var det lite vilda västern.

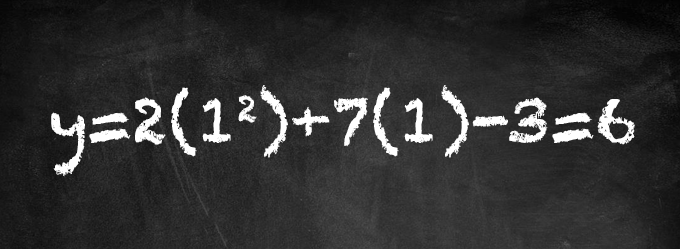

Email har sett en liknande utveckling, där man först naivt skrev in sin e-post i varenda ruta man kunde hitta på nätet, till den nuvarande situationen med sund skepcis hos konsumenter tillsammans med effektiva spam-filter. 2008 stod spam för 92% av alla email i världen, nu är vi nere på 55-60%.

Så ny teknik har alltid barnsjukdomar innan vi lär oss att hantera den, innan konsumenter utvecklar koll och reglering kommer ikapp. Det jag tycker är intressant just nu är hur AI, algoritmer och machine learning ovanpå allt som Cambridge Analytics gjort skulle kunna ta den problematiken ännu värre. Och hur långt i förväg det problemet skulle kunna hinna innan vi kommer ikapp.

Värt att fundera på innan man nästa gång klickar på ”Vilken kattunge borde du skaffa?”

Update; En riktigt spännande följdverkan av den negativa publicitet detta innebär king FB; Nordea svartlistar Facebook som investering för sina fondförvaltare i hållbara fonder. Intressant att se hur Facebook kommer bemöta den här utvecklingen..

Update 2: Marc Zuckerberg har nu gått ut med ett detaljerat uttalande, där han går igneom historiken med hur persondata delats med appar och hur den delningen utvecklats över tid. Slutklämmen är en uppdatering som innebär att:

- FB blockerar åtkomst till data för appar som du inte har använt i tre månader eller mer. Så ägarna till den där klasskompis-appen du använde 2013 kan inte koma åt info om dig länge

- Man gör en översyn av gamla appar som samlat in mycket personuppgifter. Framgår inte helt tydligt exakt hur detta skall se ut dock..

- Att minska mängden data en app kan dra ut med hjälp av en basic Facebook-inloggning. Det blir alltså en ”del min info light” och en mer avancerad nivå.

- Krav på ett undertecknat kontrakt från utvecklare som vill extrahera dina FB-inlägg eller privat information

- Peta upp information om appar och integritet i folks nyhetsflödet för att informera och ge möjlighet att ändra sina inställningar smidigt

- Berätta för folk om att deras data användes felaktigt av apparna från Cambridge Analytica.

En så kallad full pudel. Oklart hur effektiv den är, det känns som helt klart att vi inte hört det sista i den här utvecklingen..